【ニューラルネットワークの基礎研究19】

層数やユニット数による学習結果の違いについて6(関数の入力数と出力数を一致させた構造)

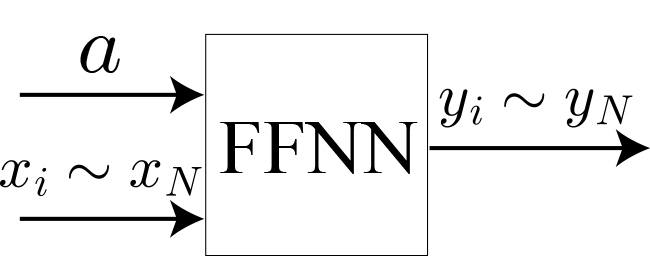

ニューラルネットワークを勉強した後に、実際の系を学習させる際に問題になるのがネットワークの構造です。

これまでは、関数の定数aと引数xを入力してその値yを受け取るという形で関数を学習させました。この方法では100,000回の学習で1変数の三角関数ですら満足のいく精度を得られませんでした。精度が上がらないのはネットワークへ入力される値の自由度が高いことが原因として考えられます。

1変数関数の場合、変数として与えられる値の範囲を等間隔に分割して入力値を固定することで自由度を定数aのみとすることができます。

本稿では、xの区間の分割数を100として両端を含めて101個とaを合わせて102個をニューラルネットワーク入力値、分割された各地点のyの値101個を出力とする構造として学習回数に対する損失値をグラフ化して学習効果を確かめます。

【これまでの結果】

→ 1変数の2次関数の学習 1 2 3 4

→ 係数が変化する2次関数の学習 1 2 3 4

→ べきが変化するべき関数の学習 1 2 3

→ 学習効果を高めるにはディープ(層数)と並列数(ユニット数)のどちらが有効か?

→ 底が変化する指数関数の学習 1 2 3

→ 関数形ごとの学習成果の比較

→ 角振動数が変化する三角関数の学習 1 2

ニューラルネットワークの基本パラメータ

・ニューラルネットワークの構造:順伝播型ニューラルネットワーク(FFNN)

・学習方法:通常の勾配法(学習率固定、逆誤差伝搬法)

・学習率:eta = 0.01;

・ミニバッチ数:100 (サンプルは無限に用意できるためミニバッチという概念は存在しませんが、ランダムに用意したミニバッチ数分のサンプルに対する平均を用いて学習を進める)

・活性化関数(中間層):ReLU(ランプ関数)

・活性化関数(出力層):恒等関数

・損失関数:2乗和

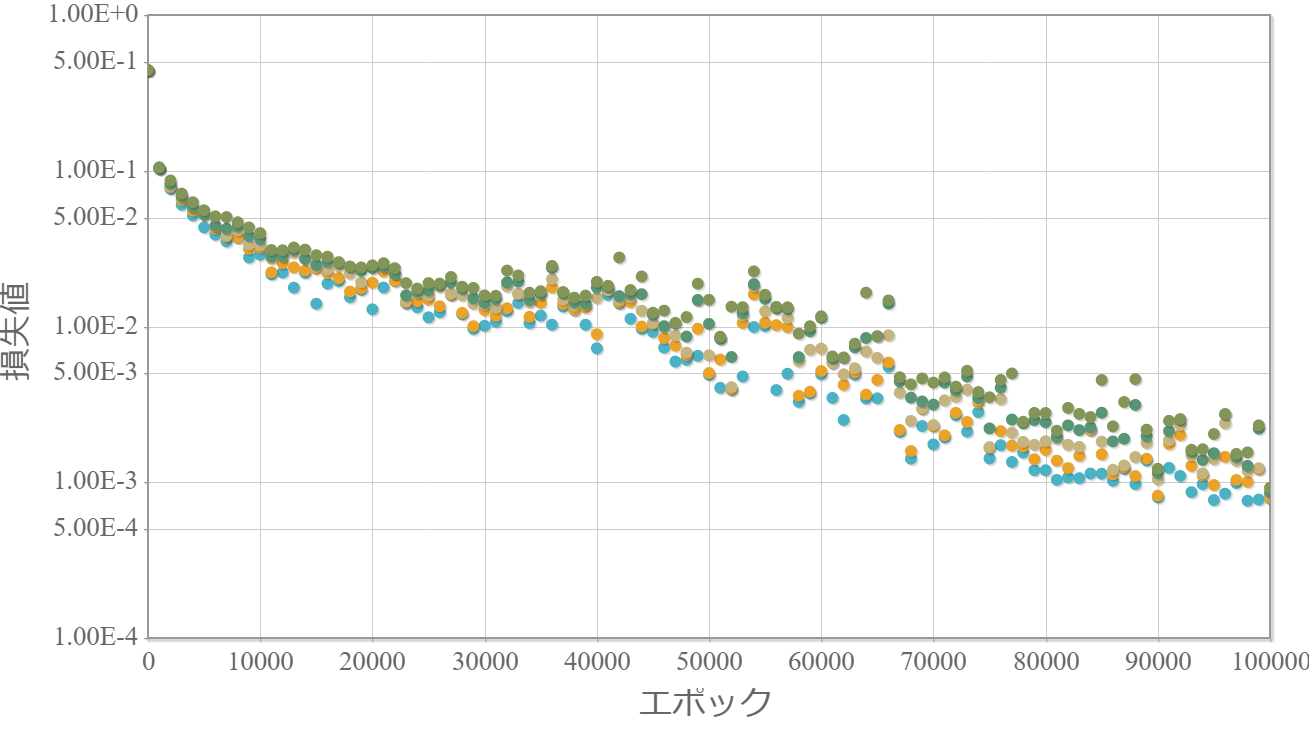

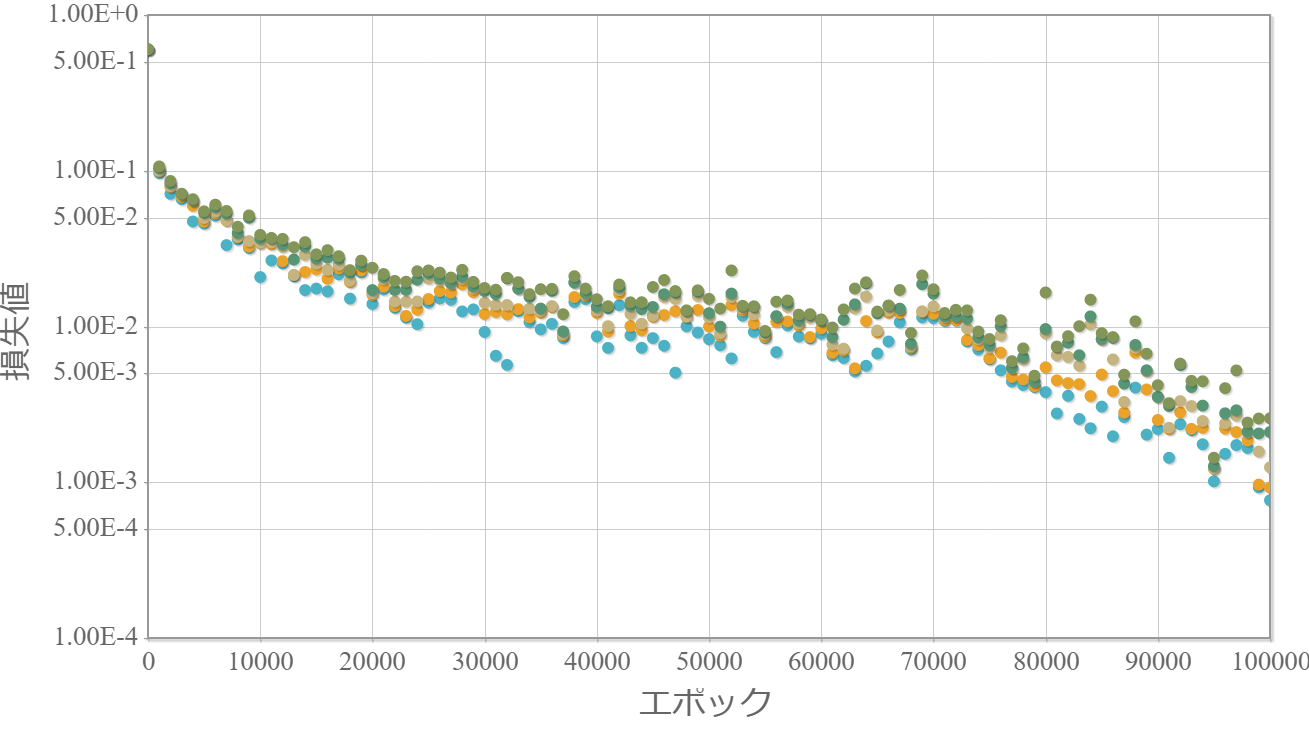

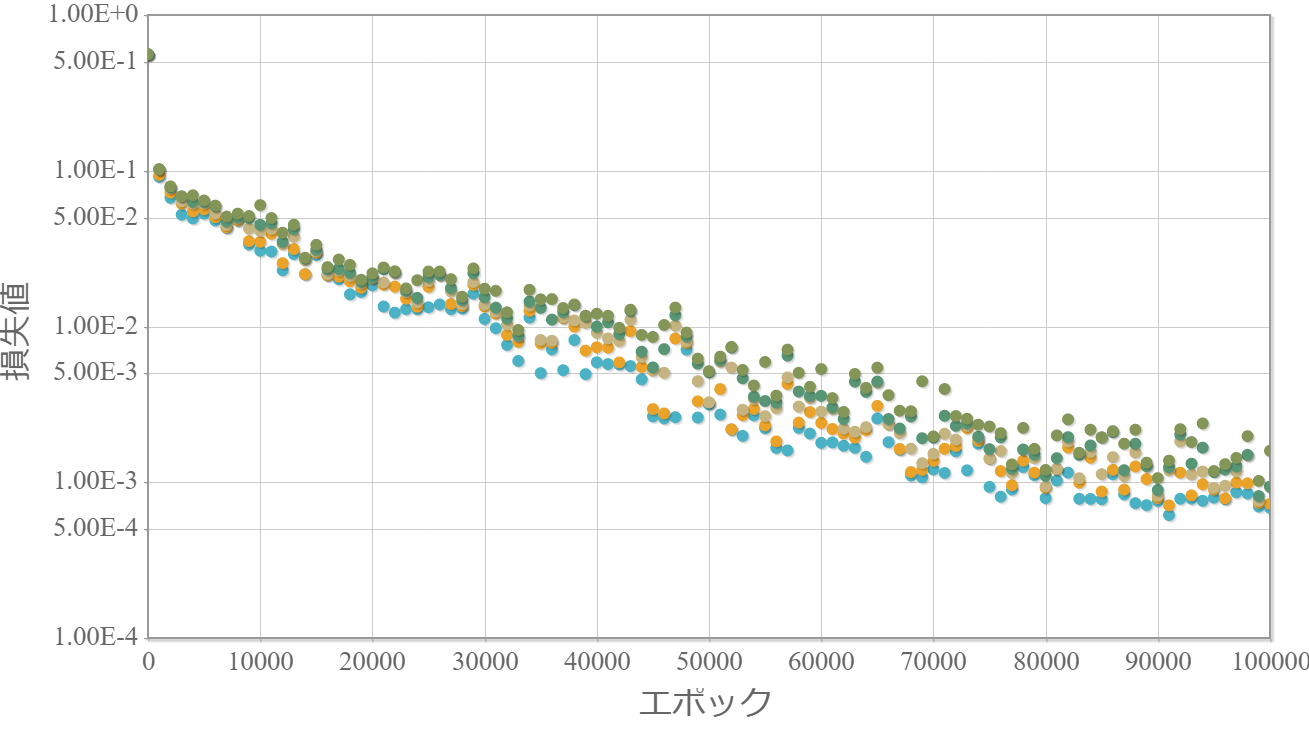

※独立したネットワークを10個用意してそれぞれ個別に学習させて、学習効果の高かった上位5つの「学習回数」vs「損失値」をグラフ化します。

※参考ページ

学習対象関数

本稿では角振動数が0から2まで変化する三角関数を学習させます。

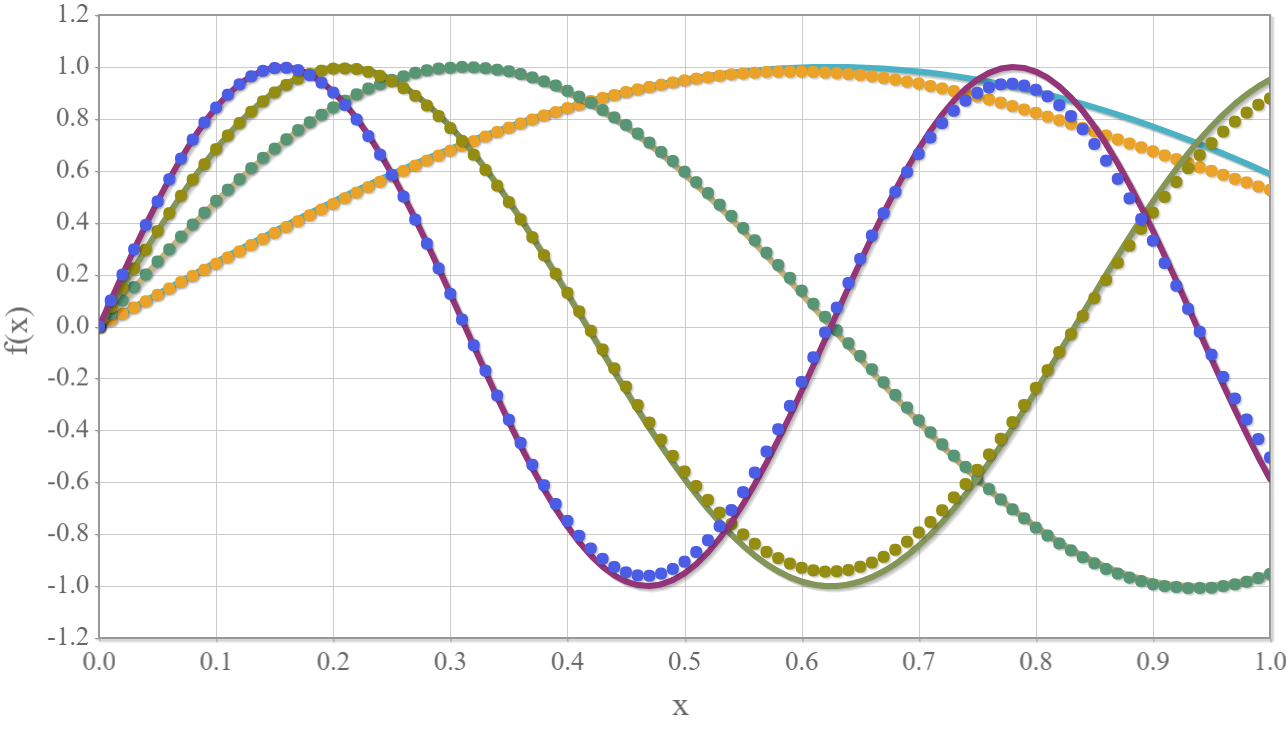

次のグラフは角振動数を0.4, 0.8, 1.2, 1.6としたネットワークの計算結果です。

※後述する「102-1000-101」ネットワークで学習した三角関数(学習回数100000回)

線が学習対象関数、点がネットワークで計算した結果です。

「102-N-101」型のニューラルネットワーク(中間層数:1)

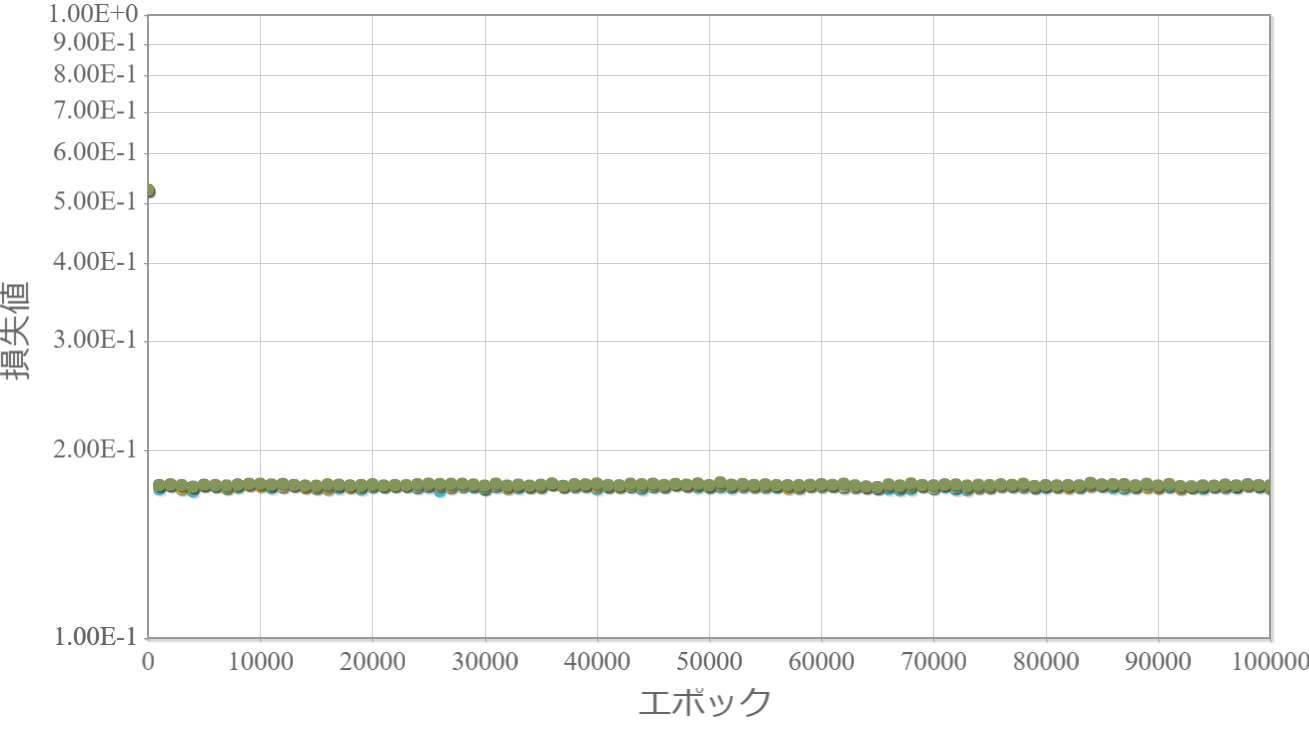

102-10-101

102-50-101

102-100-101

102-200-101

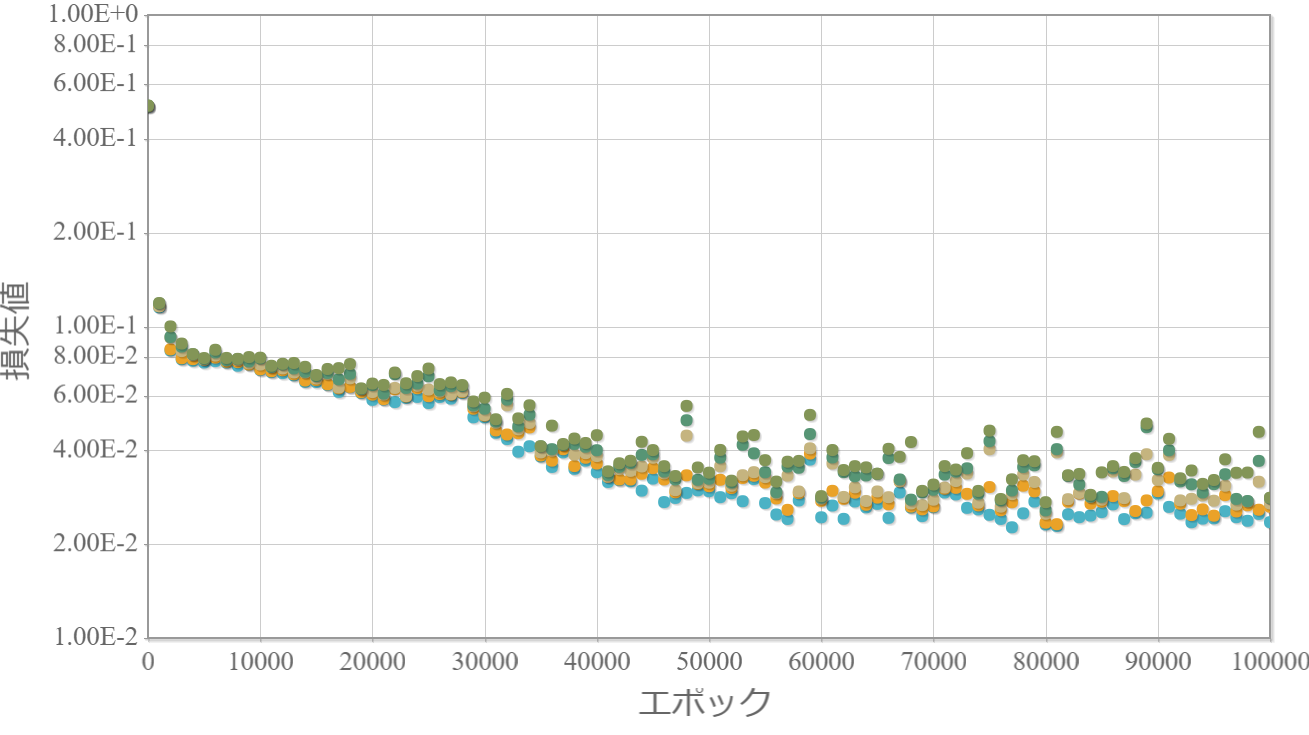

102-500-101

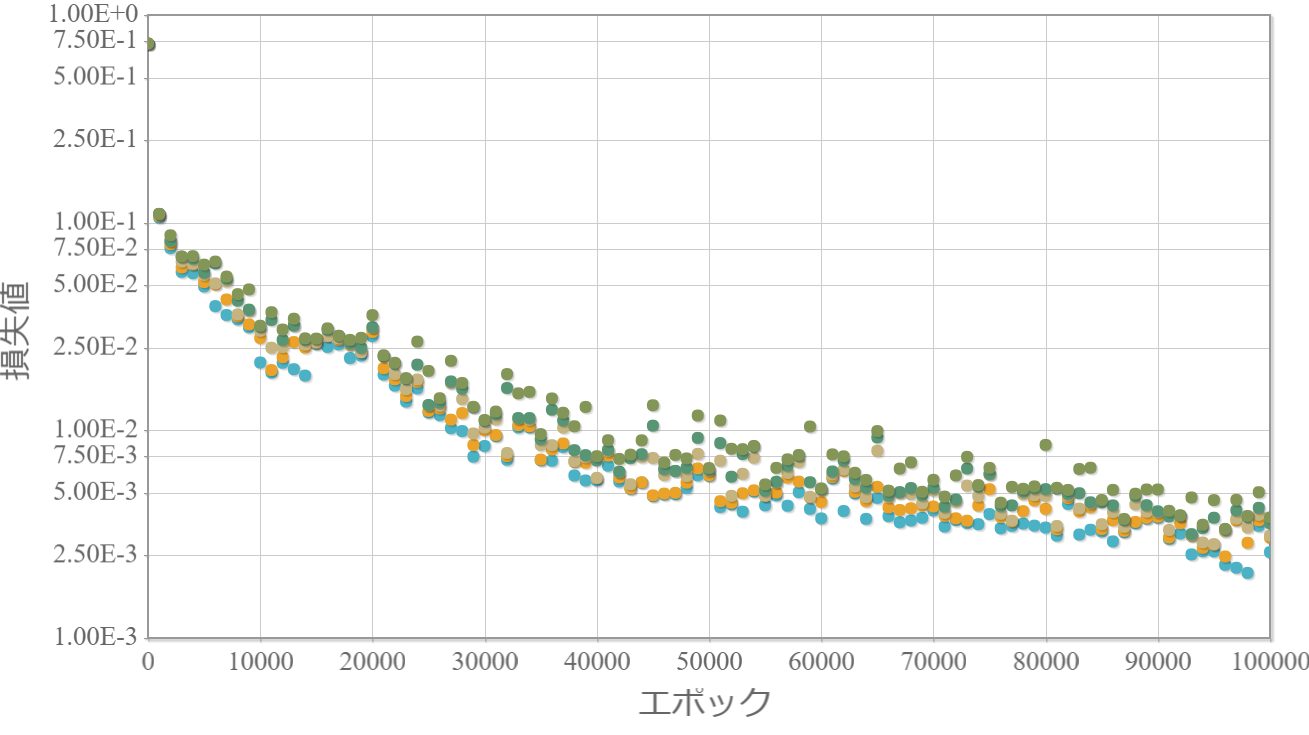

102-1000-101

考察と次の課題

・前回の「2-1000-1」と今回の「102-1000-1」を比較した場合、損失値がほぼ1/5となった。

→ 有効性が確認できた

・ただし、安定性は下がった。

次の課題

・中間層の多層化を行う

プログラムソース(C++)

・http://www.natural-science.or.jp/files/NN/FFNNs_epoch_Functions2.zip

※VisualStudio2017のソルーションファイルです。GCC(MinGW)でも動作確認しています。